Zastanawiałeś się kiedyś, jak właściwie sprawdzić, czy różne zmienne w Twoich danych mają ze sobą coś wspólnego? Właśnie do tego służy macierz korelacji! To takie sprytne narzędzie matematyczno-statystyczne, które pokazuje nam zależności między wieloma zmiennymi w zorganizowany sposób. Wyobraź sobie kwadratową tabelę pełną liczb. Każda liczba opowiada nam historię o tym, jak silnie i w jakim kierunku dwie wybrane zmienne są ze sobą powiązane liniowo. Bez niej, zagłębienie się w gąszcz danych byłoby o wiele trudniejsze. W tym artykule rozłożymy ją na czynniki pierwsze: przyjrzymy się jej definicji, tym, co ją wyróżnia, jak się ją liczy, jak czytać jej wartości, jak ją pokazać w atrakcyjnej formie, a także gdzie faktycznie można ją wykorzystać i jakie są jej wady.

Czym jest macierz korelacji? Definicja i podstawy

Macierz korelacji to po prostu kwadratowa tablica, gdzie zarówno wiersze, jak i kolumny reprezentują te same zmienne. W każdej komórce tej macierzy znajdziesz współczynnik korelacji pary zmiennych, które odpowiadają danemu wierszowi i kolumnie. Najczęściej używamy tu współczynnik korelacji Pearsona. On mówi nam, jak silny i w jakim kierunku jest liniowy związek między dwiema zmiennymi, które mierzymy liczbowo.

Macierz korelacji ma kilka podstawowych cech, które ułatwiają jej zrozumienie:

- Kwadratowa forma: Liczba wierszy jest taka sama jak liczba kolumn. Analizujemy przecież relacje między tymi samymi zmiennymi.

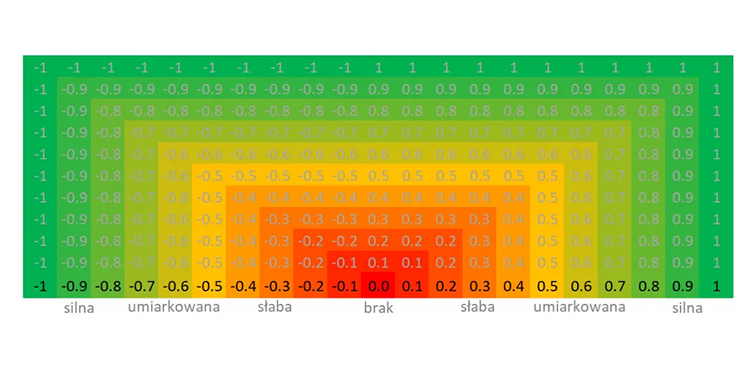

- Zakres wartości: Wszystkie liczby w macierzy mieszczą się między -1 a 1. Wartość 1 oznacza idealną dodatnią korelację, -1 – idealną ujemną, a 0 – brak korelacji liniowej.

- Symetria: Korelacja między zmienną X a zmienną Y jest identyczna jak między Y a X.

- Główna przekątna: Elementy na głównej przekątnej, czyli tam, gdzie wiersz i kolumna dotyczą tej samej zmiennej, zawsze wynoszą 1. Przecież zmienna jest idealnie skorelowana sama ze sobą!

Jak obliczyć macierz korelacji? Metody i narzędzia

Żeby obliczyć macierz korelacji, musisz po prostu policzyć współczynnik korelacji dla każdej możliwej pary zmiennych w Twoim zbiorze danych. Jak już wspominałem, najczęściej króluje tu współczynnik korelacji Pearsona. Ale w zależności od tego, jakie masz dane i co chcesz sprawdzić, możesz też sięgnąć po inne miary, na przykład współczynnik korelacji Spearmana (jeśli masz dane uporządkowane) albo Kendalla. Na szczęście, nie musisz tego robić ręcznie. Dostępnych jest mnóstwo narzędzi – od prostych arkuszy kalkulacyjnych, przez zaawansowane programy statystyczne, aż po języki programowania.

W codziennej pracy analitycznej na pewno przyda Ci się gotowe funkcje w popularnym oprogramowaniu. W Excelu, po zainstalowaniu dodatku Analysis ToolPak, znajdziesz narzędzie „Analiza danych” z opcją „Korelacja”. Jeśli pracujesz w Pythonie, biblioteka Pandas ma super prostą metodę .corr(), która błyskawicznie tworzy macierz korelacji dla Twojej ramki danych. Programy takie jak SAS (procedura PROC CORR) czy MATLAB (funkcja corrcoef) też Ci w tym pomogą. Są też specjalistyczne narzędzia jak PQStat, Gretl czy Jamovi, które mają bardzo intuicyjne interfejsy. Zanim jednak zabierzesz się do liczenia, czasem warto najpierw spojrzeć na dane przez pryzmat wykresów rozproszeń – to może dać Ci dobry pogląd na potencjalne zależności.

Kluczowe własności macierzy korelacji

Macierz korelacji to taki skondensowany opis tego, jak liniowo powiązane są ze sobą różne zmienne. Jej najważniejsze cechy sprawiają, że jest naprawdę przydatnym narzędziem w analizie statystycznej. Kiedy dobrze je zrozumiesz, łatwiej Ci będzie prawidłowo odczytać wyniki i uniknąć pomyłek. Dlatego warto pamiętać o tych podstawowych zasadach:

- Kwadratowa forma: Wynika z tego, że analizujemy relacje między tymi samymi zmiennymi.

- Zakres wartości (-1 do 1): Dzięki temu łatwo ocenić siłę i kierunek związku.

- Główna przekątna równa 1: Każda zmienna jest idealnie skorelowana sama ze sobą.

- Symetria: Korelacja X z Y jest taka sama jak Y z X.

- Wyznacznik macierzy: Dostarcza informacji o współliniowości zmiennych. Im bliżej 1, tym mniejsza współliniowość; im bliżej 0, tym większa.

Interpretacja macierzy korelacji: Siła i kierunek związku

Żeby zinterpretować macierz korelacji, musisz przyjrzeć się liczbom, które znajdują się na przecięciu poszczególnych wierszy i kolumn. Każda taka liczba (poza tymi na głównej przekątnej) to właśnie współczynnik korelacji między dwiema zmiennymi. Mówi nam on, jak silny i w którym kierunku jest ich liniowy związek. To klucz do tego, żeby dobrze zrozumieć wyniki Twojej analizy.

Każdy współczynnik korelacji mieści się w przedziale od -1 do 1.

- r = 1: To idealna korelacja dodatnia. Kiedy jedna zmienna rośnie, druga też rośnie w przewidywalny, liniowy sposób.

- r = -1: To idealna korelacja ujemna. Wzrost jednej zmiennej oznacza spadek drugiej w sposób liniowy.

- r = 0: To po prostu brak liniowej zależności między zmiennymi.

Wartości pośrednie, bliższe 1 lub -1, oznaczają oczywiście różny stopień zależności. Im bliżej końca tego przedziału jesteś, tym silniejszy związek.

Siła związku rośnie wraz z tym, jak wartość bezwzględna współczynnika zbliża się do 1. W praktyce, badacze często przyjmują pewne umowne progi, żeby określić siłę korelacji. Mogą się one różnić w zależności od dziedziny. Na przykład, wartości między 0,3 a 0,5 mogą oznaczać wystarczające korelacje, 0,6–0,7 – umiarkowane, a 0,8–0,9 – bardzo silne. Pamiętaj jednak, że w niektórych dziedzinach, jak nauki społeczne czy psychologia, nawet niższe wartości mogą być bardzo istotne, bo badane zjawiska są po prostu bardzo złożone.

Kierunek korelacji mówi nam znak liczby. Korelacja dodatnia (znak plus) to sytuacja, gdy zmienne poruszają się w tym samym kierunku – jedna rośnie, druga też. Korelacja ujemna (znak minus) oznacza, że poruszają się w przeciwnych kierunkach – jedna rośnie, druga maleje. Bardzo ważne jest, żeby pamiętać, że sama korelacja nie oznacza związku przyczynowego. To, że dwie zmienne są ze sobą powiązane, nie znaczy, że jedna jest przyczyną drugiej. Może to być przypadek albo wpływ jakiejś trzeciej, niebadanej zmiennej. Klasyczny przykład to korelacja między sprzedażą lodów a liczbą utonięć – obie rosną latem, ale lody nie powodują utonięć!

Wizualizacja macierzy korelacji

Chociaż można odczytać liczby w macierzy korelacji, to jednak wizualizacja danych sprawia, że zrozumienie złożonych relacji między zmiennymi staje się o wiele szybsze. Jednym z najpopularniejszych sposobów wizualizacji jest mapa ciepła (heatmap). Na takiej mapie każda komórka macierzy jest pokolorowana tak, żeby odzwierciedlić siłę i kierunek korelacji.

Zazwyczaj używa się takich kolorów: odcienie jednego koloru dla korelacji dodatnich (np. czerwony, pomarańczowy) i odcienie innego koloru dla korelacji ujemnych (np. niebieski, zielony). Intensywność koloru zwykle pokazuje siłę korelacji – im mocniejszy kolor, tym silniejszy związek. Jasne lub neutralne kolory oznaczają zazwyczaj niską korelację. Dzięki takiemu wizualnemu przedstawieniu od razu widzisz najsilniejsze zależności, zarówno pozytywne, jak i negatywne, a także możesz dostrzec pewne wzorce, które mogłyby umknąć podczas analizy samych liczb. Wiele narzędzi, jak biblioteka Python Pandas czy MATLAB, potrafi automatycznie generować takie wizualizacje.

Zastosowania macierzy korelacji

Macierz korelacji to takie wielozadaniowe narzędzie, które przydaje się w wielu dziedzinach nauki i analizy danych. Jej główna rola to wstępne zbadanie zależności między zmiennymi. To często pierwszy krok, zanim zastosuje się bardziej skomplikowane metody statystyczne. Dzięki niej masz szybki przegląd tego, co dzieje się w Twoich danych.

Jednym z najważniejszych zastosowań macierzy korelacji jest ocena współliniowości zmiennych. Jest to szczególnie istotne w modelach regresji wielorakiej, gdzie bardzo silnie skorelowane zmienne objaśniające mogą sprawić, że wyniki będą niestabilne. Macierz korelacji pozwala wykryć takie problemy. Może też stanowić punkt wyjścia do analizy głównych składowych (PCA) lub analizy czynnikowej. W tych metodach chodzi o to, żeby znaleźć mniejszą liczbę zmiennych, które wyjaśnią większość wariancji danych, a silne korelacje pomagają zidentyfikować zmienne, które można połączyć lub zastąpić. Macierz korelacji jest też wykorzystywana do budowania mierników syntetycznych lub wskaźników złożonych, które łączą wiele informacji w jedną, skondensowaną miarę. W finansach może pomóc w analizie ryzyka portfela inwestycyjnego, a w naukach społecznych – w badaniu powiązań między zmiennymi demograficznymi, ekonomicznymi czy psychologicznymi. Narzędzia takie jak Excel Analysis ToolPak, PQStat czy ArcGIS ułatwiają analizę korelacji.

Ograniczenia macierzy korelacji

Mimo że macierz korelacji jest bardzo użyteczna, ma też swoje wady i ograniczenia, o których trzeba pamiętać. Jeśli źle jej użyjesz albo zignorujesz te ograniczenia, możesz dojść do błędnych wniosków i podjąć złe decyzje. Dlatego ważne jest, żeby wiedzieć, czego macierz korelacji nam nie powie.

Największym ograniczeniem jest to, że standardowe miary korelacji, jak współczynnik korelacji Pearsona, mierzą tylko zależności liniowe. Oznacza to, że macierz korelacji nie wykryje relacji nieliniowych, na przykład parabolicznych czy wykładniczych, nawet jeśli są one bardzo silne. Kolejna ważna sprawa: brak korelacji nie oznacza niezależności zmiennych. Dwie zmienne mogą być statystycznie niezależne, a mimo to wykazywać silną korelację, jeśli ich związek jest nieliniowy. Problemy pojawiają się też przy silnej współliniowości (wysokim skorelowaniu) zmiennych objaśniających w modelach regresji, co może utrudnić oszacowanie parametrów modelu. Ponadto, wiele metod obliczania współczynników korelacji, w tym metoda Pearsona, zakłada pewne właściwości rozkładu danych, na przykład normalność. Jeśli te założenia nie są spełnione, wyniki mogą być niemiarodajne. Analizy typu PCA lub analiza czynnikowa też wymagają spełnienia pewnych warunków (np. KMO ≥ 0,5, istotny test Bartletta), które często weryfikuje się właśnie na podstawie macierzy korelacji.

Podsumowanie i wnioski

Macierz korelacji to podstawowe narzędzie w analizie statystycznej, które pokazuje nam liniowe zależności między parami zmiennych w zbiorze danych. Pozwala szybko ocenić siłę i kierunek tych relacji, co jest nieocenione podczas eksploracji danych. Jej symetryczna struktura, wartości w przedziale <-1, 1> i informacje o głównej przekątnej sprawiają, że jest łatwa do zrozumienia, a wizualizacje typu mapa ciepła jeszcze bardziej ułatwiają jej interpretację.

Macierz korelacji jest nieodłącznym elementem przygotowania do bardziej zaawansowanych metod analizy wielowymiarowej, takich jak PCA czy analiza czynnikowa. Pomaga też w identyfikacji problemów, takich jak współliniowość. Trzeba jednak pamiętać o jej ograniczeniach: mierzy tylko zależności liniowe, brak korelacji nie oznacza niezależności, a sama korelacja nie implikuje związku przyczynowego. Zrozumienie macierzy korelacji otwiera drzwi do głębszej analizy danych i lepszego pojmowania relacji między zmiennymi, ale trzeba jej używać świadomie, weryfikując założenia i interpretując wyniki w odpowiednim kontekście.

Masz pytania dotyczące macierzy korelacji albo potrzebujesz pomocy w analizie swoich danych? Odezwij się do naszego zespołu ekspertów! A jeśli masz własne doświadczenia z macierzą korelacji, podziel się nimi w komentarzach poniżej!

FAQ – najczęściej zadawane pytania o macierz korelacji

Czym różni się macierz korelacji od macierzy kowariancji?

Macierz kowariancji mówi nam, w jakim stopniu dwie zmienne zmieniają się razem, a jej wartości zależą od skali tych zmiennych. Macierz korelacji standaryzuje te wartości, usuwając wpływ skali, i pokazuje tylko siłę i kierunek liniowego związku w zakresie od -1 do 1. Jest często używana, gdy zmienne mają różne jednostki lub skale.

Czy silna korelacja zawsze oznacza związek przyczynowy?

Absolutnie nie. Korelacja pokazuje tylko, że zmiany w jednej zmiennej wiążą się ze zmianami w drugiej. Może istnieć trzecia, ukryta zmienna (tzw. zmienna zakłócająca), która wpływa na obie analizowane zmienne, albo związek może być zwykłym przypadkiem. Pamiętaj, żeby nie mylić korelacji ze związkiem przyczynowym.

Jakie są najczęstsze metody obliczania współczynnika korelacji?

Najczęściej stosuje się:

- Współczynnik korelacji Pearsona: dla danych ilościowych o rozkładzie normalnym.

- Współczynnik korelacji Spearmana: dla danych porządkowych lub gdy założenie o normalności nie jest spełnione.

- Współczynnik korelacji Kendalla: również dla danych porządkowych, często używany przy mniejszych próbach.

Czy macierz korelacji może wykryć nieliniowe zależności?

Standardowe współczynniki korelacji, takie jak Pearsona, mierzą głównie zależności liniowe. Nie są skuteczne w wykrywaniu złożonych, nieliniowych zależności między zmiennymi. W takich przypadkach lepiej zastosować inne metody analizy lub wizualizacje (np. wykresy rozproszeń), żeby zidentyfikować potencjalne nieliniowości.

Poszukujesz agencji SEO w celu wypozycjonowania swojego serwisu? Skontaktujmy się!

Paweł Cengiel

Cechuję się holistycznym podejściem do SEO, tworzę i wdrażam kompleksowe strategie, które odpowiadają na konkretne potrzeby biznesowe. W pracy stawiam na SEO oparte na danych (Data-Driven SEO), jakość i odpowiedzialność. Największą satysfakcję daje mi dobrze wykonane zadanie i widoczny postęp – to jest mój „drive”.

Wykorzystuję narzędzia oparte na sztucznej inteligencji w procesie analizy, planowania i optymalizacji działań SEO. Z każdym dniem AI wspiera mnie w coraz większej liczbie wykonywanych czynności i tym samym zwiększa moją skuteczność.